Yesterday I was invited to hold a key note speech at the closing ceremony of the first German-Danish summer academy at Fachhochschule Kiel.

For today I will just put the whole speech online. Links and pictures are to follow next week.

Dear Ministerpräsident Albig, dear professor Klausner, dear honorary consul Bormann, dear ladies and gentleman,

my dear colleagues,

Thank you for the opportunity to share some of my concerns about the future of journalism with you.

Sound training and a focus on regional issues –as at this summer-school – are certainly two promising remedies that can address the media crisis – especially the crisis among regional newspapers.

If you think, you know what you see on this picture,

(thanks to bildblog.de to point at that story.)

(The picture is still online – with a wrong subline http://www.sueddeutsche.de/wissen/neil-armstrong-ist-tot-still-und-weise-1.984317-3

If you believe that it was Hans-Joachim Friedrichs who originated the idea, that journalists should not fight for any cause, even not for a good one.

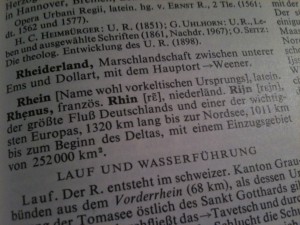

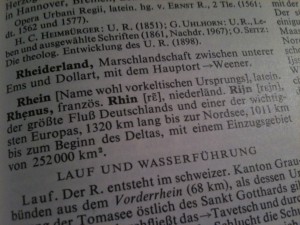

And if you trust your encyclopaedia at home that it will have the length of the river Rhine correctly …

… then you are likely, to make factual mistakes. Which is no problem – unless you work in a profession where facts matter. In journalism facts matter a lot – if our audience cannot trust us on these, we are lost. Factual accuracy is therefore at the core of journalistic virtues and will stay with our profession no matter where it moves technically – whether it will still be printed on paper or broadcast in a linear manner as we know it. When we talk about fact-checking, we want to ensure that facts are being checked before they get published. For those of you who are not involved in journalism (or exposed to journalism for other professional reasons) this might come as a surprise: But in general journalists -outside the US-publish what they consider to be facts without having these cross-checked by a second person.

Let’s look at some examples:

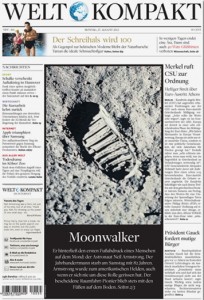

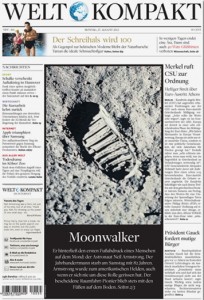

The frontpage of Süddeutsche Zeitung – Monday one week ago.

This suggests that this is the footprint of Neil Armstrong, but it isn’t. It’s that of his colleague Buzz Aldrin. The actual wording that the newspapser used here – doesn’t say it is his footprint. So at the very least, this is not very accurate.

But this one went for the full mistake: Saying this is Neil Armstrong’s footprint – which is false. (That story too was covered by bildblog.)

And while Süddeutsche had mirrored the picture, “Die Welt” had it upside down.

If you look into this matter, you will learn that there was even a debate on what Neil Armstrong actually said when he stepped out.

(source: Nasa)

And there is no longer any doubt that he dropped the article “a” in his famous “one small step for a man” which would have changed the meaning. Thus the famous quote is only what Armstrong intended to say – without actually saying it.

You might feel that all this is a bit nerdy – to discuss whether an astronaut dropped an article while he was doing something that is truly breathtaking. Why discuss whose footprint that is – as long as it is a footprint on the moon? To me journalism is a profession that cares about precision, about detail – and about getting as close to the truth as feasible. That’s why I care. Or as one of my bosses had it: If you do not get the names and figures right, why should we trust your story anyway? (More over it helps a lot, once companies take you to court for alleged false reporting.)

Fact-checking shall ensure that you have proof, or even two sources of proof. And often we do not cross-check because we are pretty sure that we know something by heart.

But this can turn out to be very tricky:

(article in Süddeutschen Zeitung: http://www.sueddeutsche.de/wissen/der-rhein-ist-kuerzer-als-gedacht-jahrhundert-irrtum-1.24664)

(article in Süddeutschen Zeitung: http://www.sueddeutsche.de/wissen/der-rhein-ist-kuerzer-als-gedacht-jahrhundert-irrtum-1.24664)

The river Rhine is 90 kilometres shorter than our schoolbooks or printed encyclopaedias have it. That’s almost the length of the Kiel canal that got lost here – due to transposed digits.

Who argued that journalists shouldn’t fight for any cause, even if it is a good one?

It was not Hans Joachim Friedrichs but Charles Wheeler at the BBC from whom Friedrichs got that way of thinking.

What was John F. Kennedy referring to, when he made his famous quote “Ich bin ein Berliner”?

He did not feel like a Berliner nor did he intend to say he was a citizen of Berlin and he did not want to create a slogan to draw tourists to the city. Instead he was referring to ancient Rome – when the proudest thing one could say was “I am a citizen of Rome.” because that menat to have civil rights.

For Kennedy the sixties equivalent was “Ich bin ein Berliner.”

[editorial annotation, added November 12th: Kennedy used that phrase twice: The second time was at the end of his speech. There the quote can be interpreted as -in one particular way- feeling like a Berliner or that he is a citizen of Berlin – but still Berlin here was meant as the modern equivalent of Rome, i.e. a free city in the democratic Western World. So he too was a free man living in the free democratic Western World and -as the Berliners- was not a citizen of the evil East. My speech is using the altered quote at the end to reflect this.]

In many cases false facts are not just based on human error, time pressure and the like, but on PR-people trying to get their story through – with a bias the pleases their clients.

Fact checking will help to show up such stories that are mainly based on one source only.

(The article is still online: http://www.sueddeutsche.de/wirtschaft/verpackungsindustrie-comeback-der-dose-1.953813)

(The article is still online: http://www.sueddeutsche.de/wirtschaft/verpackungsindustrie-comeback-der-dose-1.953813)

Like this one that we examined last week and which is full of factual mistakes.

And yes again, it’s Süddeutsche Zeitung. I do not intend to say, that they make more mistaktes than others. I actually like that newspaper very much – but don’t we tend to be very rigorous on the ones we like the most?

Checking such facts hardly takes place. On the slide you see how Der Spiegel treats facts. They have a department staffed with around 100 people trying to eliminate or at least to reduce the amount of mistakes. According to one well documented account – this means that 1153 changes have been made due to the fact-checking of one issue only. This count includes 559 mistakes and another 400 cases where the fact-checking lead to more precision. Some of these mistakes probably were only made because the journalists at Der Spiegel are fully aware that their magazine has fact-checkers and mistakes will be erased before going to the printing press. So journalists at Spiegel bother less to avoid mistakes because of the fact-checking.

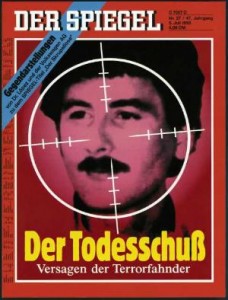

However, despite the enormous effort Der Spiegel still makes mistakes –

(article in the archive of Spiegel: wissen.spiegel.de/wissen/image/show.html?did=87908010&aref=image052/2012/08/25/CO-SP-2012-035-0088-0088.PDF&thumb=false)

(article in the archive of Spiegel: wissen.spiegel.de/wissen/image/show.html?did=87908010&aref=image052/2012/08/25/CO-SP-2012-035-0088-0088.PDF&thumb=false)

in last week’s issue our Danish participants saw that they mistook one Danish politician for another and hence printed the wrong picture.

Some papers run correction columns regularly – including Spiegel and Süddeutsche – which is good because everybody will tend to continue making mistakes as long as nobody cares about them. Moreover it is a message to the readership: This paper cares about accuracy. Factual mistakes and other shortcomings must at least be talked about – they must be a regular topic in staff meetings.

Bigger mistakes are often not talked about for years.

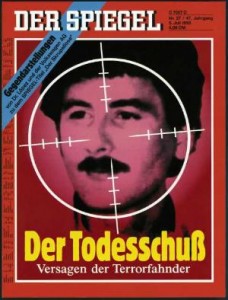

(link to that issue in the Spiegel archive: http://www.spiegel.de/spiegel/print/index-1993-27.html)

Like this Spiegel cover story that even made the German Home Secretary, Innenminister Seiters, resign – but –at its core – was false. It is very rare that journalists talk about their mistakes and admit that they have been wrong. In this case Hans Leyendecker frankly admitted that he was wrong – which makes him an even greater investigative journalist than he already is.

And of course he did not publish that false story on purpose – he was very sure that he was right.

In many cases you will start to fact-check and then come up with a story in its own right.

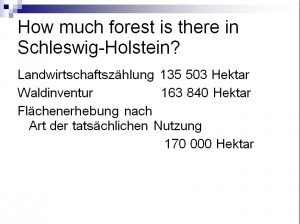

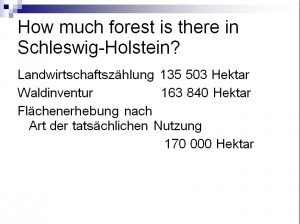

In another case a journalist wondered about how many hectares of forest there are in Schleswig-Holstein

And he found no less than three official statistics on what was meant to be one figure only:

One of the may reasons behind these discrepancies is that in one definition, it doesn’t matter in what federal state the trees of a forest are but where the citizen who owns the forest lives. If you look into that dataset – Hamburg looks like a huge forest.

(For the full article klick here: http://www.abendblatt.de/region/article1834083/Dichter-Statistik-Dschungel-im-Norden.html)

(For the full article klick here: http://www.abendblatt.de/region/article1834083/Dichter-Statistik-Dschungel-im-Norden.html)

This was not intended to be a story on facts only. The government here spent money on increasing the forest area in this state. So looking into the statistic was decisive on whether that money had an effect.

Fact-checking can even lead to investigative stories

This was an advertisement under the red-green government. Claiming that those companies on the chalk board had established new apprenticeship-jobs – Ausbildungsplätze.

We were asked to fact-check it. And came up with a quite different account.

That is governmental PR in disguise and should belong to our key tasks as journalists. But no other journalist investigated that – although it was printed in Der Spiegel. Seymour Hersh, the great American investigative journalist who uncovered the My Lai massacre in Vietnam in 1968 and whom you probably heard of last when he uncovered the Abu Ghraib torture procedures and pictures in 2004, said « Governments lie. We don’t lie, we make mistakes but we’re not liars, that’s the difference. »

So even if we journalists do not lie on purpose – we do not always care very much about accuracy.

Unfortunately we do not have external quality controls in place for our media. We get reports on pesticides in our food, of the nasty bits of small print in insurance contracts and on hazardous toys, but we do not have consumer reports on the quality of our media. This is a structural problem because it is a hindrance for competition in quality. So if we complain that the media only compete in market share, this is due to a lack of alternatives.

By the way – it is not only consumer reports missing here, but consumer rights. You cannot return a newspaper because of factual mistakes nor can you reclaim your money or asked for a corrected version.

Why is factual accuracy so vital for the future of journalism? Today everybody can publish and – different from ten years ago – everybody who wants to be read can publish and will be found by his or her audience. Many newspapers over here still have not realised why blogs became such a buzz and they openly display that by nick-naming blogs as “Online-Tagebücher”, explaining to their readers, that blogs are just online diaries. They are not. They are powerful means of publication. If you should decide to start a blog on local politics in Kiel tonight, by tomorrow everybody who googles – say for the name of the candidates for mayor ship- will find your blog. (Actually if you google for my name plus some key words from this speech, you’ll find that online tomorrow morning as well.) During the “old world wide web” this would have been a process of weeks if not months. It is important to understand that the web 2.o introduced technologies that make user-generated content not only easy to generate but more importantly: easy to find. Hence we should no longer use the term “Online diaries”. Otherwise we journalists might end up thinking that it is very difficult to replace journalism by private diaries. This is no longer true. Today you no longer need a publisher, a printing press or a broadcast station to share your stories. That is a problem for those owning such equipment, but it is not necessarily a problem for journalists. We have all heard about the media crises, diminishing revenue from advertisements and the search for new sustainable sources of income, but so far this has been done from the publisher’s perspective only. From my perspective as a reader, it looks quite different: Up to today I pay my newspaper for printing news on paper and to deliver the paper in the early morning, while the publisher acquires advertisement to pay for the content. From a consumer’s perspective – I am not paying for content, but for convenience – printing and delivery. So nobody should wonder that I dislike paying for content – I am simply not used to it. In tomorrow’s world consumers will pay for their digital devices and for internet access – so they already pay for their convenience and expect content in exchange for paying some attention to advertisements. This is still a business model – Spiegel Online and Bild.de are profitable. I would like to make a political remark here since the Leistungsschutz-Gesetz still has to pass Bundesrat. So Ministerpräsident Albig will have two more arguments on top of what his party’s working group is already advocating:

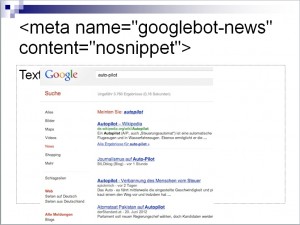

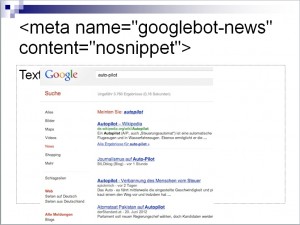

– First: Every publisher today is able to withdraw from Google completely or to deny Google to use their content. There is a lot of talk that Google makes profit from publisher´s content, because they display not only the headline of an article and the link to it but, two lines of content. Every webmaster can change that within minutes and stop Google from showing those two lines or from indexing their content at all.

Please see Stefan Niggemeier’s blog for the full story.

– Second: Publishers profit a lot from Google and Facebook – because online they are the main pathways to bring readers to them. Especially those publishers who advocate that strange piece of legislation the most, I name Springer and Burda, are the ones who spent a lot of money on search engine optimisation – apparently because it pays off for them. I repeat this re-phrased: They pay for automatically generated content and for training and consultancy to optimise their profit from Google. Knowing that, it is rather strange to hear them now claiming the whole situation is vice versa and Google should pay.

Moreover these strategies of search engine optimisation could be considered unfair – to competitors and to the reader, because readers will quite often end up at a news page where they don’t get a good article but a short agency piece instead.

– (For the full argument on this please consult Stefan Plöchinger’s blog, the editor in chief at sueddeutsche.de)

So what should publishers do instead? What should we journalists concentrate on? What is it that could distinguish journalists from the other folk who publish nowadays? In the age of Twitter – you do not have to own a wire network to be the first to report. But coming from that tradition – speed is still seen as an important criteria in journalism. But today, if publishers go for fast news, they end up with all the others having the same news. In my opinion there is no doubt that media will no longer create great revenue from mainstream news – and please do not even think of making your audience pay for that. Hence it is a good idea to stress different journalistic virtues: accuracy, exclusiveness and good story-telling. All this is a long-term-project, but if you do not engage in this, you are less likely to survive in journalism for more than another decade. If you imagine yourself the number of editors who are busy monitoring and editing the news agency feeds in order to fill their federal and foreign policy sections or to write some, usually not very insightful, commentary, you see the very workforce that publishers should employ to do something better. Something that gives greater or added value to their readership.

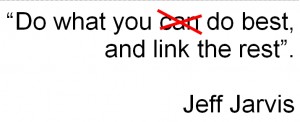

What could that be? – In a broad, if not global competition where access to media is ubiquitous and cheap, every publishing house should concentrate on what they are best at. They should no longer compete in areas where they cannot be first grade players. This is the paraphrased mantra on how to survive in the digital age as a business – Jeff Jarvis originally meant this to be an advice to bloggers:

“Do what you do best, and link the rest”.

Footnote: Until Tuesday evening I had this quote slightly wrong – until I fact-checked it.

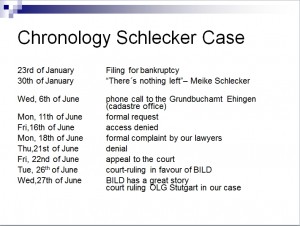

On a national level we see that background information – going beyond the day-to-day reporting of he-said-she-said and the tiny advancements our news reports on a particular international conflict or this or that political debate – is valued more than ever. If you look at “Die Zeit”, a national weekly, you see a lot of things well done: long stories by distinguished journalists, background on what is going on and what will be going on. And – that’s good news – it appears to be paying off for them – their circulation is rising against the trend. For regional papers something they could do best is clearly reporting on their region, on the communities. That will even include going hyperlocal, that is, covering what is going on in smaller sections of a city or region. Editors and reporters in the regions know their area and readership, they should be most important to their papers. Whereas a regional paper does not necessarily need a lot of staff on federal and even international politics. If you no longer need to edit federal policy you can do stories nobody else is assigned to. Especially in a regional environment it is very easy to be unique. The story on how big the forests are in this state, is a small example – but it is unique and still most journalists could have written it. Moreover this story matches two criteria that I always employ when I have to decide whether something is good enough for publication. I call that “Weitererzähl-Faktor” and it has a two-fold meaning: Is the story interesting and outstanding enough so that it is likely that my audience will like to pass it on – literally, as a copy or link or as we now say “share it with their community”? And: Is the story told in a comprehensible way so that everybody who heard about it can easily retell the story? Before I come to an end, let me return to fact-checking for a moment and share with you an amazing story that actually became my biggest defeat this year – so far. In January a big retailer, Schlecker, went into insolvency- they could no longer pay their bills. One week later the daughter of the owner declared that even the wealth of the family had gone – no assets left, although they were believed to be billionaires.

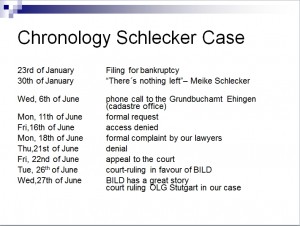

Very soon there were many rumours on where the family was keeping their assets. And whether they had transferred some of it in order to keep it – including their private estate. But nobody investigated it – while the rumours where spread all over. There is hardly any newspaper that did not repeat these rumours. It was reported that the wife of the company’s founder and CEO owned the house where they live but nobody was sure since when that was the case.

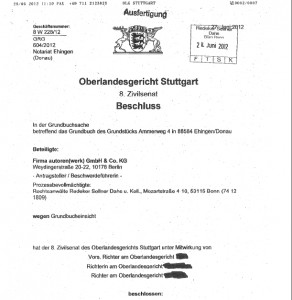

If the estate had been transferred while the company was already in trouble, such a transfer would have been illegal. Initially we did not touch the story, because we were afraid of too much competition. Three months later, I still wondered why it should be so difficult to get facts on who owns the estate and especially since when it was owned by that person. On June 6th I asked our trainee to call the cadastre office –Grundbuchamt – in order to request that info. The amazing part of the answer was not that they denied us access to the data, but that we were the first and only journalists who had called by then.

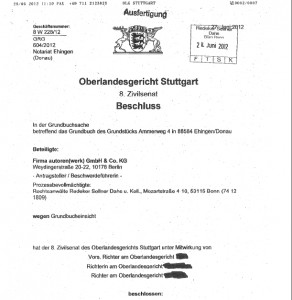

That encouraged us to proceed, so we made a formal inquiry, got a formal denial and decided to go to court with that. Whenever I suggest such an appeal in theory, journalists will reply that this will consume time and money. Here I can prove them wrong:

Within five days we a got a positive court-ruling and the fixed layers’ fee for this is about 150 Euros.

Unfortunately on the day we got the court-ruling BILD-Zeitung already had the full story plus the documents. They were second to request the data, but overtook us during the appeal procedure by one day.

If in this case there were only two journalists requesting this data, you can imagine that in most cases journalists requesting data from governmental authorities will be the only ones to do so. And again: That can make your journalistic product unique. If you look for further directions on where to go in order to generate unique content, I suggest a close look into data-journalism: the audience loves graphics, comparison and especially data about their region. No matter if you provide details on the homes for the elderly in your region in order to help people in their decision-making or if you analyse the crime statistics – you are very likely to produce good and unique journalism. Currently we see that –enhanced through the open data movement and the various freedom of information acts – more and more official data is being made available, but currently we do not have more than one or two dozen journalists who can analyse such data in Germany. The situation in Denmark actually is a lot better because training in computer assisted reporting there –as in general in Scandinavia – has been going on for a decade already.

If in this case there were only two journalists requesting this data, you can imagine that in most cases journalists requesting data from governmental authorities will be the only ones to do so. And again: That can make your journalistic product unique. If you look for further directions on where to go in order to generate unique content, I suggest a close look into data-journalism: the audience loves graphics, comparison and especially data about their region. No matter if you provide details on the homes for the elderly in your region in order to help people in their decision-making or if you analyse the crime statistics – you are very likely to produce good and unique journalism. Currently we see that –enhanced through the open data movement and the various freedom of information acts – more and more official data is being made available, but currently we do not have more than one or two dozen journalists who can analyse such data in Germany. The situation in Denmark actually is a lot better because training in computer assisted reporting there –as in general in Scandinavia – has been going on for a decade already.

My second hint is on how you handle your agenda. Media theory has it that journalists have an agenda setting-function, but a lot of journalism I see appears rather to be agenda-driven. I started as a local reporter at 17 and know very well what it means to cover anniversaries, the general assembly of the local sports club and hand-shake events with the mayor. Most of this is boring –not only for the reporter, but for the audience too. So why shouldn’t we aim at finding better stories that connect to these events? Take for example the jubilee of a local company. If you assign a reporter to that story a day before, you get the event covered plus a handshake-picture on top. If you prepare the event in time – you could dig out some ancient pictures and documents from the local archive, find retired workers and get quotes from other businesses dealing with the company. All this is not much work – if you prepare in time. And it is no big secret which companies have jubilees next year, it is a matter of research.

So let us actively demand information from our governments, question whatever story we are told – by officials as well as by companies! Let us care about detail and accuracy. Make up your mind, what topics should be on the agenda and where you do not want to followw the agenda that PR-people are setting. Start with sound facts, look into the details and then come up with great stories!

If you do so and if you care about our shared journalistic virtues, I am positive that throughout this century we can still take our pride in saying:

“I am a journalist.”

Thank you for your attention.

(article in Süddeutschen Zeitung: http://www.sueddeutsche.de/wissen/der-rhein-ist-kuerzer-als-gedacht-jahrhundert-irrtum-1.24664)

(article in Süddeutschen Zeitung: http://www.sueddeutsche.de/wissen/der-rhein-ist-kuerzer-als-gedacht-jahrhundert-irrtum-1.24664)

(The article is still online: http://www.sueddeutsche.de/wirtschaft/verpackungsindustrie-comeback-der-dose-1.953813)

(The article is still online: http://www.sueddeutsche.de/wirtschaft/verpackungsindustrie-comeback-der-dose-1.953813) (article in the archive of Spiegel: wissen.spiegel.de/wissen/image/show.html?did=87908010&aref=image052/2012/08/25/CO-SP-2012-035-0088-0088.PDF&thumb=false)

(article in the archive of Spiegel: wissen.spiegel.de/wissen/image/show.html?did=87908010&aref=image052/2012/08/25/CO-SP-2012-035-0088-0088.PDF&thumb=false)

(For the full article klick here: http://www.abendblatt.de/region/article1834083/Dichter-Statistik-Dschungel-im-Norden.html)

(For the full article klick here: http://www.abendblatt.de/region/article1834083/Dichter-Statistik-Dschungel-im-Norden.html)

If in this case there were only two journalists requesting this data, you can imagine that in most cases journalists requesting data from governmental authorities will be the only ones to do so. And again: That can make your journalistic product unique. If you look for further directions on where to go in order to generate unique content, I suggest a close look into data-journalism: the audience loves graphics, comparison and especially data about their region. No matter if you provide details on the homes for the elderly in your region in order to help people in their decision-making or if you analyse the crime statistics – you are very likely to produce good and unique journalism. Currently we see that –enhanced through the open data movement and the various freedom of information acts – more and more official data is being made available, but currently we do not have more than one or two dozen journalists who can analyse such data in Germany. The situation in Denmark actually is a lot better because training in computer assisted reporting there –as in general in Scandinavia – has been going on for a decade already.

If in this case there were only two journalists requesting this data, you can imagine that in most cases journalists requesting data from governmental authorities will be the only ones to do so. And again: That can make your journalistic product unique. If you look for further directions on where to go in order to generate unique content, I suggest a close look into data-journalism: the audience loves graphics, comparison and especially data about their region. No matter if you provide details on the homes for the elderly in your region in order to help people in their decision-making or if you analyse the crime statistics – you are very likely to produce good and unique journalism. Currently we see that –enhanced through the open data movement and the various freedom of information acts – more and more official data is being made available, but currently we do not have more than one or two dozen journalists who can analyse such data in Germany. The situation in Denmark actually is a lot better because training in computer assisted reporting there –as in general in Scandinavia – has been going on for a decade already.