Ich war am 26. Oktober auf Einladung der Adenauer-Stiftung in Belgrad, um als Keynote-Speker und Teilnehmer eines Panels über Recherche-Journalismus zu sprechen. Das Manuskript meiner Keynote dokumentiere ich hier – es ist ungeschliffen, da ich anhand von Schlagwörtern frei gesprochen habe.

Alle Medien, egal ob Zeitung oder Fernsehen, egal ob auf dem Balkan, in Westeuropa oder in Amerika können ohne einen Mehraufwand an Zeit und Geld mehr Recherche anstoßen, durchführen und veröffentlichen.

Wir verschwenden zuviel Zeit auf Unnützes und haben deshalb das Gefühl, es bliebe keine Zeit – für Recherche, Analyse, das Finden originärer Themen. Zeit wird natürlich immer benötigt für Besprechungen, Organisatorisches etc. aber selbst wenn wir uns nur anschauen, was Journalisten an Journalistischem während ihrer Arbeitszeit tun, lässt sich schnell eine Fehlallokation, eine Verschwendung von Ressourcen feststellen. Meine Erfahrungen beziehen sich auf Deutschland – es würde mich aber wundern, wenn es hierzulande oder überhaupt irgendwo weltweit ganz anders wäre.

a) Vielen Veranstaltungen, Pressekonferenzen etc. werden von Dutzenden von Journalisten besucht, ohne dass sich beobachten ließe, dass sich die Berichte später grundlegend unterscheiden. Wie auch – jede gestellte Frage – wandert auch in den Block des Kollegen. Es ist das inverse Prinzip von Exklusivität, dennoch geben wir viel Geld dafür aus. Dabei stehen sich die Kollegen vor Ort eher im Weg. (Das Gegenargument, jeweils für das eigene Publikum noch einen Mehrwert zu destillieren, die besondere Herangehensweise zu finden, trägt m.E. nicht weit.)

b) Land auf, Land ab sind in Deutschland Hunderte von Journalisten damit beschäftigt, das Material von Nachrichtenagenturen zu sichten, zu bearbeiten zusammenzufügen. Auch hier ist nicht zu erkennen, dass der starke Wettbewerb, der hier herrschen müsste, besonders gute Ergebnisse hervorbringt. Auch hier ist der Mehrwert nicht zu erkennen. Durch das Internet wird das sichtbar und die Leser werden sich künftig aussuchen können, was sie wo lesen.

Zwischen dem, was die Journalisten einer Redaktion tun sollten, und dem was sie besser lassen und von Agenturen übernehmen sollen, lässt sich leicht unterscheiden: Was können sie denn wirklich besser als die Agenturen? Wo können wir unserem Publikum mehr bieten als die Agenturen? Getreu der Parole des Internet-Gurus Jeff Jarvis: Do what you can do best and link the rest! Eine Redaktion soll das tun, was sie am besten kann, was sie für ihr Publikum wichtig macht und all das sein lassen, wo nur “me-too-Produkte” erstellt werden.

Wenn wir heute die Zukunft des Journalismus diskutieren, geht es vor allem um die Zukunft der Zeitung, des ältesten Mediums für Journalismus. Zeitungen sterben, die Auflagen sinken. Wenn sich in der Zukunft alle Redaktionen auf das konzentrieren, was sie am besten können, sehe ich vor allem folgende 5 mögliche Entwicklungen:

1.) Die Spezialisierung wird zunehmen, der Redakteur, der alles –vor allem aber redigieren und zusammenschreiben – kann, wird von der Regel zur Ausnahme.

2.) Das größte Hindernis für einen weltweiten Journalismus, der sich auf je das konzentriert, was jede Redaktion am besten kann, ist die Sprache. Im Moment sind es vor allem die englischsprachigen Medien, die von der Globalisierung des Journalismus durch das Internet profitieren. Der Guardian hat online monatlich 35 Millionen unique visitors. Für alle anderen Nationen heißt das vor allem eins: Wir brauchen mehr Journalisten, die als Übersetzer arbeiten, aber unter journalistischen Bedingungen also schnell, mit Sachkenntnis in ihrem Ressort und der jeweiligen Sprache übersetzen können.

Das könnte auch eine große Chance für Nachrichtenagenturen werden: Wenn Sie das Beste zu allen weltweiten und nationalen Ereignissen liefern – Klammer auf im Original oder in der Übersetzung – wäre das ein Grund, sich stärker auf sie zu verlassen.

3.) Das Lokale oder auch „hyper-lokale“ – wir interessieren uns schon immer am meisten für die Ereignisse in unserer nächsten Umgebung. Viele Medien haben das vergessen und bekommen heute Konkurrenz aus der Blogosphäre. Es ist unverständlich, dass gerade die Regionalzeitungen ihre einstige Stärke, die letztlich sogar ihre Existenzberechtigung darstellt, vergessen haben. (Ich selbst in Berlin kann überhaupt gar keine Zeitung abonnieren, die auch nur annähernd so viel Lokales liefert wie es einer Kleinstadt heute noch üblich ist.)

4.) Wer von einem Ereignis detaillierter, brillanter, sprachlich interessanter berichtet, als alle anderen – also der gute Reporter, dessen Arbeit an Schriftstellerei heranreicht, wird immer sein Publikum finden. Wer künftig über die Rettung der Chilenischen Minenarbeiter berichtet, muss das besonders gut machen.

5.) Und – bis auf weiteres – ist und bleibt Recherche eine Marktlücke. Es wird zu wenig recherchiert – damit meine ich nicht nur investigative Recherchen. Es fängt an bei fehlender Präzision und Faktenfehlern – allein hier lässt sich noch viel an Qualität hinzugewinnen. Zeit für Recherche lässt sich ohne weiteres gewinnen, wenn wir Journalisten uns auf das konzentrieren, was wir besser können als andere.

Den Einwand, dass nicht jeder, der heute Nachrichten redigiere, morgen zum investigativen Reporter werden kann, möchte ich nicht gelten lassen. Wenn Sie „große“ Rechercheure hören und fragen, was man für die investigative Recherche braucht, so werden sie Ihnen sagen: Erfahrungen und Kontakte.

Ich arbeite sehr viel mit jungen Journalisten – da macht es keinen Sinn auf Erfahrungen und Kontakte zu verweisen – denn dann warten die jungen Kollegen und warten und werden vielleicht nie eine vernünftige Recherche auf den Weg bringen. Aber nicht nur aus diesem didaktischen Grund glaube ich nicht an das Mantra der Rechercheure, dass Erfahrungen und Kontakte alles seien. Ich setze dagegen auf gute Ideen, Methodik und vor allem auf viel Fleiß.

Erst, wenn die eigene Erfahrung reflektiert und analysiert wird, wird daraus Methodik, Handwerkszeug, etwas das man anderen vermitteln kann. Wer immer nur auf die eigene Erfahrung verweist, weiß vermutlich gar nicht, was er wirklich erfahren hat – weil er es nicht analysiert hat.

Um loszulegen, ist es hilfreich, sich auf machbare und relevante Recherchen zu konzentrieren. Die schwer machbaren Recherchen neigen dazu, Zeitfresser zu werden und keine Ergebnisse zu bringen. Um dennoch große Geschichten zu machen, muss man die großen Thesen in Teile zerlegen und sich immer wieder fragen, was können wir jetzt schon berichten und was können wir mit einem Tag oder einer Woche mehr noch dazu gewinnen. (Oft bringen Teilveröffentlichungen auch strategische Vorteile.) Ich kenne mehrere Redaktionen, die so arbeiten – in keiner darf jemand ein halbes Jahr an einem Thema arbeiten ohne Rechenschaft abzulegen.

Abgesehen davon, dass sehr viele Recherche heute ohne großen Kostenaufwand durchgeführt werden können, (ich meine damit nicht nur das Internet, sonder vor allem auch das Telefon) gilt auch hier, dass Recherche vor allem von einer Umverteilung von Ressourcen profitieren kann. Geld lässt sich aber auch genauso wie Zeit rationieren – jeder will wissen, was für sein Geld bekommt – auch Ihr Chef oder meine Auftraggeber. Auch hier hat es sich ebenso bewährt, schrittweise vorzugehen und Ziele zu definieren – was ist sicher machbar, was wäre maximal machbar – für ein bestimmtes Budget.

Wenn jemand zu mir kommt und Geld für eine Auslandsreise will, weil man vor Ort ja mehr raus bekäme, ist das aussichtslos. Erst müssen die Hausaufgaben gemacht werden. Im August habe ich drei Kollegen für mehrere Tagen nach Spanien geschickt, nachdem sie mit ihrer Recherche zuhause sehr weit gekommen waren. Sie hatten so ziemlich alles, was man von Deutschland aus recherchieren konnte, zusammengetragen und die Chancen standen gut, dass wir zumindest einen in Deutschland gesuchten Betrüger finden könnten, da wir Informationen zu dreien hatten. Am Ende wurden es dann 2 von 3 gefunden – Menschen, die in Deutschland von den Behörden (Staatsanwaltschaften) nach wie vor gesucht werden.

Abgesehen von meinen Überlegungen hier, bleibt es natürlich immer richtig – wenn wir Journalisten nicht wie hier unter uns sind – mehr Geld und mehr Zeit für Recherche- Journalismus zu fordern. 😉

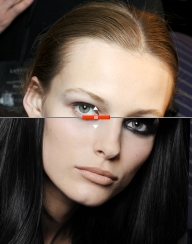

Ungeschminkte Bilder zeigt die New York Times (T Magazine Blog): Bilder bekannter Models, wie sie (anlässlich der New York Fashion Week) publiziert wurden: unerreichbar schön. Und dieselben Bilder, bevor Visagist und Friseur Hand anlegten. Für jedes Bild ist angegeben, wer der Photograph ist und wer das Model (und von welcher Agentur), wer das Makeup besorgte und wer die Frisur.

Ungeschminkte Bilder zeigt die New York Times (T Magazine Blog): Bilder bekannter Models, wie sie (anlässlich der New York Fashion Week) publiziert wurden: unerreichbar schön. Und dieselben Bilder, bevor Visagist und Friseur Hand anlegten. Für jedes Bild ist angegeben, wer der Photograph ist und wer das Model (und von welcher Agentur), wer das Makeup besorgte und wer die Frisur.