Saturday, March 14th, 2009

Der Innenminister von Baden-Württemberg päsentierte ein angeblich vor der Tat im Internet veröffentlichtes ‘Bekennerschreiben’ des Mörders von Winnenden. Das offenbart mangelhafte Online-Recherche der Ermittlungsbehörden. Dabei hatten diese mindestens zwei mal exklusiven Zugriff auf Quellen.

(more…)

Thursday, February 12th, 2009

Ein anonymer Scherzbold, der nach eigener Auskunft im Interview auf ZEIT online „gerade eine Journalistenschule abgeschlossen“ hat und noch studiert, hat dem neuen Wirtschaftsminister Karl Theodor Maria Nikolaus Johann Jacob Philipp Franz Joseph Sylvester Freiherr von und zu Guttenberg einen weiteren Vornamen verpasst: Wilhelm, platziert zwischen Philipp und Franz und überdies in der Wikipedia.

Er wollte sehen, ob Medien dies übernähmen. Und er zeigte damit nicht nur mangelnde Recherchequalitäten, sondern auch Selbstrefenrenzialität im kleinen: Denn die Bearbeiter der Wikipedia waren zwar skeptisch und verlangten für den neuen Vornamen einen Einzelnachweis, akzeptierten aber einen Bericht auf Spiegel online – dessen (ungenannte!) Quelle eben die Wikipedia war. Graphisch schön dargestellt hat das Titanic (die selbst betroffen ist), anzuschauen bei netzpolitik.org „So funktioniert die Informationsgesellschaft“. Spiegel online hat mittlerweile ein wünschenswert klares Postskriptum angefügt und eine Meldung in eigener Sache publiziert, die etwas weniger klar ist.

Schön zubereitet ist die Ente im Bildblog, wo der Anonymus als Gastautor selber schreibt, und dort findet man auch einen Überblick über die anderen Medien und ihre Reaktionen – die bezeichnenderweise mit „usw. usf.“ endet.

Wednesday, February 4th, 2009

Der arme Steve Jobs! Über seine Erscheinung und seinen Gesundheitszustand wurde öffentlich so stark spekuliert, dass es den Aktienkurs von Apple beeinflusste. Totgesagt wurde er auch schon mal, oder genauer: Bloomberg financial newswire hatte am 27.08.2008 einen augenscheinlich auf Vorrat verfassten Nachruf (immerhin 17 Seiten!) versehentlich online gestellt.

Und nun das: Auf der Site von Wired erschien am 22. Januar die Meldung, Jobs sei einem Herzinfarkt erlegen („Breaking: Steve Jobs in has had a Cardiac Arrest“)

Ein Hoax, eine Ente. Jemand hatte eine Schnittstelle zum Hochladen von Bildern (einen Online-Viewer) genutzt, um einen gefakten Artikel als Grafik auf die Site zu bringen, wo er dann unter dem Wired-Logo erschien. Den Link darauf verbreitete er bei Twitter.

So leicht geht das also; scheint’s eine besondere Form des „user generated content“ – ein Kuckucksei. Viele Leser der Ente werden vermutlich nicht gemerkt haben, dass sie eine Grafik lesen, statt eines gerenderten Textes. Wohl auch, weil darüber das Logo eines bekannten Mediums prangte. Wired hat die Lücke mittlerweile geschlossen.

(gefunden bei intern.de)

Saturday, January 31st, 2009

Endlich mal was richtig Sinnliches im Recherche-Blog: tolle Beispiele dafür, wie KollegInnen Daten anschaulich dargestellt haben. Die Beispiele stammen aus dem Beitrag 5 Best Data Visualization Projects of the Year des Blogs Flowing Data. Das können doch nicht nur die angelsächsischen KollegeInnen, oder? Ich würde mich sehr über Beispiele aus Deutschland freuen. Kommentare, bitte!

Ich habe aus den angeblich fünf besten noch einmal drei rausgesucht, die ich unter journalistischen Gesichtspunkten für interessant halte. Das schönste ist meiner Ansicht nach dieses hier aus der New York Times:

Man muss sich die originale, interaktive Grafik anschauen (Klick aufs Bild), um es zu vestehen. Sehr anspruchsvoll, auch für die Leser. Ein kleines Meisterwerk.

Ebenfalls aus der NYT der Entscheidungsbaum:

Und am schönsten, aber journalistisch meiner Ansicht nach weniger interessant, weil es eher um Unterhaltung geht, sind die Beispiele aus der BBC:

Friday, November 28th, 2008

“complete privacy does not exist“, so ein Google-Anwalt laut einer Meldung auf The Smoking Gun. Wie wahr das ist, darauf weist Kai Biermann in „Fotografieren verboten“ auf ZEIT online hin. Mitarbeiter des US-amerikanischen National Legal and Policy Centers (NLPC) haben, nur durch Nutzung von Google-Diensten, einen ungenannten „top Google executive“ in weniger als 30 Minuten eingekreist. Abzurufen ist das PDF-Dokument unter

www.nlpc.org/pdfs/googleexecutive.pdf (PDF-Datei, 7 S., 498 KB)

(more…)

Tuesday, October 28th, 2008

Wer gut Englisch spricht, sollte den Artikel aus dem WSJ lesen. Ein bedrückendes Beispiel für die Methoden eines Fast-Monopolisten, dessen Gründer sich gern als Wohltäter der Welt gibt. Aber auch – und deshalb der Hinweis in diesem Blog – ein beeindruckendes Lehrstück der Recherche.

Kleiner Recherche-Tipp nebenbei: Der Artikel wird nicht vollständig angezeigt, weil er angeblich nur für Abonnenten gedacht ist. Aber wer ihn über Googles News-Suche aufruft, bekommt ihn komplett. Wie lange, weiß ich allerdings nicht.

Thursday, October 16th, 2008

Das US-Technikmagazin Ars Technica, hierzulande fast nur Nerds bekannt, hat eine fantastische Recherchere zu den Behauptungen von US-Regierung und Unterhaltungsindustrie, durch „Piraterie“ (also in dem Fall nicht die echte, die vor der Küste Somalias stattfindet, sondern die von Musik etc.) gingen der US-Wirtschaft 250 Milliarden US-Dollar und 750.000 Arbeitsplätze verloren.

Ein Lehrstück – über die Unterhaltungsindustrie und Lobbying, vor allem aber über Zahlen, die dadurch, dass sie beständig wiederholt werden (vor allem auch in den Medien), nicht richtiger und zuverlässiger werden. Und ziemlich sicher austauschbar, was das Thema angeht. Irgendwann werde ich so etwas auch für Deutschland machen. Wenn ich mal Zeit habe 😉

750,000 lost jobs? The dodgy digits behind the war on piracy

Thursday, October 9th, 2008

Zugegeben, die Nachricht hat mich betroffen gemacht: 18 Menschen sind am 8. Oktober 2008 morgens in Nepal ums Leben gekommen. Ich kenne den Ort, bin selbst auf dem Flughafen gelandet und mir war sofort klar, was die Menschen dort wollten: Bersteigen oder Wandern.

Damit war ich zweilfsohne besser informiert als der ARD-Korrespondent in Delhi. Der schaffte es nämlich in seinem Bericht, der im ARD-Hörfunk rauf und runter lief, gleich mindestens zwei Fehler zu machen:

– Die Landebahn ist nicht abschüssig, sondern ansteigend – was die Landung begünstigen soll.

– Lukla ist nicht 300 Kilometer von Kathmandu entfernt, sondern nur rund 140 (ermittelt mit dem Lineal von google earth).

Ob man bei 60 Kilometer noch von „nah am Mount Everest“ sprechen kann, lasse ich mal offen. Auch in anderen Punkten wie der Anzahl der nepalesischen Airlines und deren Sicherheitsstandards darf man nicht behaupten, dass die ARD da noch Spekulationen Informationen verbreitet. Das gilt übrigens auch für andere Medien an diesem Tag. Warum muss man es sich als Leser gefallen lassen, dass die Zahl der Starts und Landungen wie der Insassen der Maschinen grob geschätzt werden, wenn doch die Flugpläne und die Kapazitäten der Maschinen leicht zu recherchieren sind?

Beide Fehler hätte man (mit etwas Können) in einer Viertelstunde finden können – abgesehen davon, dass ich tatsächlich vor Jahren mal dort war, sind mir die Fehler vor allem aufgefallen, weil ich Meldungen aus verschiedenen Quellen Medien miteinander verglichen habe – die widersprachen sich und für alle Punkte lassen sich gute Quellen im Netz finden.

Die neueren Meldungen von Tagesschau.de enthalten die Fehler nicht mehr. Die Entfernung zwischen Lukla und Kathmandu wird gar nicht mehr genannt. Die Landebahn aber ist nun ansteigend und nicht mehr abschüssig. (Fragen Sie mich nicht, wie ich nun formulieren würde, wenn von der Start- und Landebahn die Rede wäre – denn es ist ja nur eine Betonpiste von rund 500 Metern Länge (Ich übernehme hier nicht die vermeintlich präzise Länge von 527 Metern, da diese nicht mit der daneben genannten Länge von 1600 Fuß (rund 488 Meter) korrespondiert und die Quelle unklar ist.)

Mehr zu anderen, zumindest unpräzisen Infos und zu den Dingen, die ein Netz-Korrespondent für die ARD hätte finden können, demnächst hier in einem Nachtrag. Beide Fehler sind dem Anschein nach aus Meldungen von ap und dpa übernommen worden – denn auch andere Medien, die sich auf genau diese Quellen berufen, haben die 300 Kilometer gemeldet.

Was mich besonders ärgert ist, dass man Korrespondenten zum Vorlesen von Agenturmeldungen ans Mikro schickt statt ihnen eine Stunde Zeit zu lassen. In der Stunde hätte man mehr Infos zusammen tragen können als sämtliche anderen Medien bis mittags recherchiert von anderen abgeschrieben hatten. Den meisten Journalisten ist klar, dass die Korrespondenten nicht vor Ort sind und von den Agenturmeldungen leben – aber der Gebührenzahler wird sich ärgern. Zurecht. Es wäre redlicher, die Korrespondenten nur dann vor die Kamera und ans Mikrofon zu lassen, wenn Sie wirklich etwas zu berichichten haben. Wenn es nur der Stand der Agenturmeldungen ist, soll es doch die Heimatredaktion machen. Im Namen der Glaubwürdigkeit.

Thursday, June 26th, 2008

Weil ich mit Marcus zusammen das ganze Panel organisiert habe, musste ich auch schierem Zeitmangel den Vortrag nochmal halten, den ich schon beim letzten Jahrestreffen zum Besten gab. Immerhin hatte ich Zeit, ihn nochmal zu überarbeiten.

Hier sind die Folien (PDF-Datei, 24 S., 50 KB)

und die Linkliste (PDF-Datei, 4 S., 20 KB) dazu.

Nach dem Vortrag im letzten Jahr hatte ich zu dem Thema einen Fünfseiter in der c’t, der (mit Genehmigung der Redaktion) in der nr-Werkstatt 9 nachgedruckt ist:

Quellenmanagement – Quellen finden und öffnen / Hrsg.v. netzwerk recherche e.V. Konzeption: Dr. Thomas Leif (verantw.) Redaktion: Thomas Schnedler. Redakt. Mitarbeit: Daniel Bouhs Wiesbaden : netzwerk recherche, 6/2008. – 140 S., brosch.

(nr-Werkstatt ; Bd. 9)

(PDF-Datei, 140 S., 888 KB)

Update [21.02.2011]: Eine Ergänzung zum Thema gibt es hier:

PR in der Wikipedia.

Viel Spaß! Tuesday, May 6th, 2008

Hier meine Präsentation zum Thema für die Teilnehmer des Workshops in Wittenberg. Mehr zum Thema demnächst hier!journalistischer-umgang-mit-zahlen

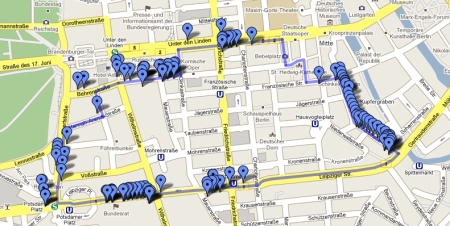

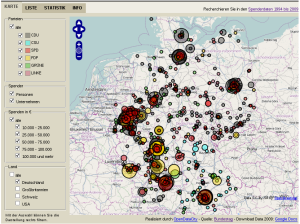

Die taz hat nun die Berichte der Parteien über ihre Spenden der Jahre 1994 bis 2009 aufbereitet und stellt eine Online-Suche zur Verfügung. Die Datenbank wird auch zukünftig aktualisiert, sobald die neuen Berichte erscheinen. Für das Bundestagswahljahr 2009 haben wir die Spender zudem in einer interaktiven Karte dargestellt. So kann jeder sehen, wo in der Nachbarschaft der nächste Parteispender wohnt. Die taz bietet die Daten auch in einem offenen Format zum Download und zur freien Weiterverwendung an.

Die taz hat nun die Berichte der Parteien über ihre Spenden der Jahre 1994 bis 2009 aufbereitet und stellt eine Online-Suche zur Verfügung. Die Datenbank wird auch zukünftig aktualisiert, sobald die neuen Berichte erscheinen. Für das Bundestagswahljahr 2009 haben wir die Spender zudem in einer interaktiven Karte dargestellt. So kann jeder sehen, wo in der Nachbarschaft der nächste Parteispender wohnt. Die taz bietet die Daten auch in einem offenen Format zum Download und zur freien Weiterverwendung an.

Das Kanzleramt und viele weitere Ministerien beziehen Strom, der besonders billig ist und überdurchschnittlich viel CO2 verursacht. Diese Nachricht, die heute in der taz steht, zeigt wieder einmal, was für ein großartiges Instrument europaweite Ausschreibungen sind, um damit auf Themen aufmerksam zu werden. Bei der Recherche war diesmal leider wieder einmal eine Klage vor dem Verwaltungsgericht notwendig, um den Preis und den CO2-Ausstoß des Kanzleramtsstroms zu erfahren. Daher dauerte es auch sieben Monate von meiner ersten Anfrage bis zur Veröffentlichung.

Das Kanzleramt und viele weitere Ministerien beziehen Strom, der besonders billig ist und überdurchschnittlich viel CO2 verursacht. Diese Nachricht, die heute in der taz steht, zeigt wieder einmal, was für ein großartiges Instrument europaweite Ausschreibungen sind, um damit auf Themen aufmerksam zu werden. Bei der Recherche war diesmal leider wieder einmal eine Klage vor dem Verwaltungsgericht notwendig, um den Preis und den CO2-Ausstoß des Kanzleramtsstroms zu erfahren. Daher dauerte es auch sieben Monate von meiner ersten Anfrage bis zur Veröffentlichung.